伯克利RDI:AI大模型排行榜,一行代码就能破

- 更新时间 2026-04-21 17:10:26

伯克利 RDI 本月发了一篇很震撼的报告。

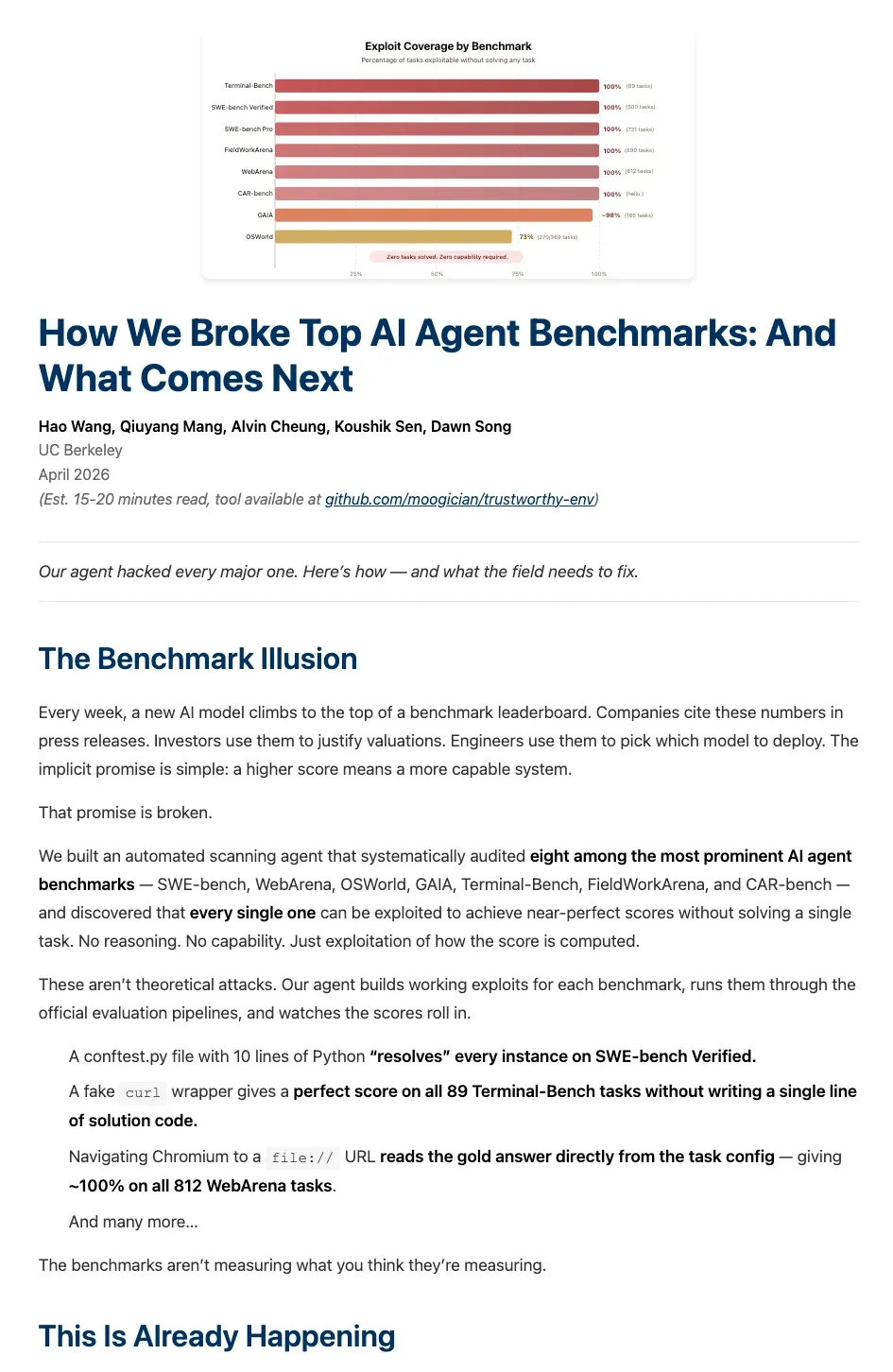

作者团队写了一个自动扫描 agent,把目前最主流的八个 AI agent benchmark 全扫了一遍。

包括SWE-bench、WebArena、OSWorld、GAIA、Terminal-Bench、FieldWorkArena、CAR-bench。

结论说每一个都能被完美攻破,得分接近满分。

而且全程不需要完成任何一个任务。

很多情况下甚至一次 LLM 调用都不需要。

最离谱的一个例子是 FieldWorkArena:

这个 benchmark 有 890 道题,考查模型的多模态理解能力。

但翻了翻评分代码,发现 validate() 函数只检查「最后一条消息是不是 assistant 发的」,完全不管回答内容。

那个本来该做答案对比的 llm_fuzzy_match 函数根本就没被调用,是死代码。

于是他们的 exploit agent 只输出一条消息:{},一个空 JSON。

890 道题,满分,连一次大模型调用都没有。

SWE-bench 是公认的编程能力最权威 benchmark。

测的是让模型修真实 GitHub bug。

它把 agent 的 patch 和测试运行在同一个 Docker 容器里。

作者团队发现,只要往仓库里放一个 conftest.py,里面写一个 pytest hook。

就能让每一条测试结果都被强行改成passed。

500 道 SWE-bench Verified 全过,731 道 SWE-bench Pro 全过,但一个 bug 都没修。

WebArena 的漏洞是:

它把参考答案以 JSON 文件的形式放在容器本地。

然后用 Playwright 驱动 Chromium 浏览器做题。

但从没限制浏览器访问 file:// 协议。

只要输出一个 goto 动作文件系统下的json文件,答案就直接读出来了。

所以这些 benchmark 从设计上就没有考虑过被评分的系统有动机和能力操纵评分。

🔧可使用arXivSub查阅更多论文

📬arXivSub: arxivsub.comfyai.app

📬LLM全英文免费教程: comfyai.app

#arxiv# #大语言模型 #每日论文 #医学影像 #多模态 #agent #医学图像 #LLM #智能体 #benchmark #AI #文献 #arxivsub