上周,François Chollet 和 Sam Altman 同台了。一个是 ARC-AGI 的设计者,一个是经常说「我们基本上已经造出了 AGI」的人。Chollet 公布了 ARC-AGI-3 的测试结果。人类通过率:100%。最强 AI 通过率:0.37%。这不是打脸,这是照 CT。

▲ ARC Prize 官网博客:Announcing ARC-AGI-3

省流版

一、ARC-AGI-3 是有史以来第一个「交互式」AGI 测试。不是做题,是玩游戏。没有说明书,没有规则,没有目标提示。AI 必须自己探索、自己发现规则、自己找到通关方法。二、所有顶级模型全军覆没。Gemini 3.1 Pro 得了 0.37%,GPT-5.4 得了 0.26%,Claude Opus 4.6 得了 0.25%,Grok-4.20 直接 0 分。486 个普通人类测试者全部通关,中位时间 7.4 分钟。三、这个测试揭示了一个概念叫「参差不齐的智能」(jagged intelligence)。AI 能写代码、能通过律师考试,但面对一个 7 岁小孩都能搞定的探索游戏,完全不知道该怎么办。四、200 万美元奖金。两条赛道。全球开放。五、争议也来了。一个叫 Seed IQ 的系统声称 100% 通关,但被参赛规则排除在外。

从做题到玩游戏

要理解 ARC-AGI-3 为什么重要,得先回顾它的前两代。

2019 年,Chollet 发布了 ARC-AGI-1。核心思路很简单:给 AI 看几个输入输出的例子,让它推导出变换规则,然后应用到新输入上。本质是视觉模式识别。这个测试当时非常有效,但随着模型能力提升逐渐被解决。2024 年底 OpenAI 的 o3 模型就在 ARC-AGI-1 上拿到了 87.5% 的高分。

2025 年 3 月,ARC-AGI-2 发布,要求更深层次的推理。NVIDIA 的 NVARC 用 40 亿参数模型拿到了 24%。进步很快,但还是在「做题」的范畴里。

ARC-AGI-3 彻底换了赛道。

它不再是静态拼图。它是一系列交互式游戏环境。每个环境是一个 64×64 的网格,16 种颜色,5 个基本动作加一个撤销键。听起来很简单?关键在于:没有任何说明。

没有人告诉你这个游戏是干什么的。没有人告诉你什么是「赢」。没有人告诉你哪些操作会产生什么效果。你必须自己点、自己试、自己观察变化、自己推导规则、自己发现目标。

论文把这套能力框架分了四个维度:探索(主动收集信息)、建模(构建可泛化的世界模型)、目标设定(自主识别目标)、规划与执行(制定和实施策略)。讲真,这四个维度基本上就是我们说的「通用智能」的核心要素。

▲ arXiv 论文:ARC-AGI-3: A New Challenge for Frontier Agentic Intelligence

0.37% vs 100%

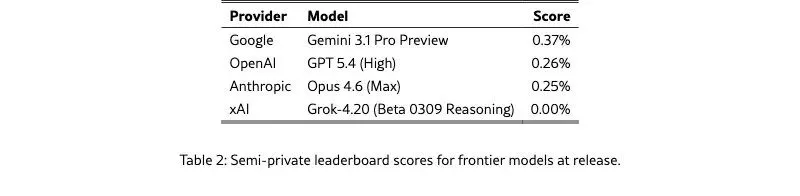

让我把 leaderboard 摆出来。

▲ 半私有集官方成绩:所有顶级模型得分不到 1%

没有凑巧。这些是目前世界上最强的 AI 模型。它们能写出复杂的分布式系统代码,能在 SWE-bench 上解决真实的 GitHub issue,能通过几乎所有的学术考试。但在一个普通人 7 分钟就能通关的游戏面前,它们集体交了白卷。

人类这边呢?486 个测试者,来自不同职业背景(注意,不是 AI 研究者,是普通人),2893 次尝试,总共 427.9 小时的游戏时间。100% 的环境都有至少两个独立的人类完成了通关。成功通关的中位时间是 8.1 分钟。

评分方式也值得说一下。ARC-AGI-3 用的是 RHAE(相对人类动作效率)评分。公式大致是:单关得分 = min(1.0, 人类步数/AI步数) 的平方。也就是说,如果你用了比人类多一倍的步数,你的分数不是减半,而是只剩四分之一。这个平方惩罚非常狠,逼迫 AI 不只是「能完成」,而且要「高效完成」。

「参差不齐的智能」

ARC-AGI-3 论文里有一个概念让我印象特别深:jagged intelligence,翻成中文就是「参差不齐的智能」。

什么意思呢?现在的 AI 模型在某些看起来很难的任务上表现出色(写代码、做数学证明、打辩论),但在某些看起来很简单的任务上完全不行(在一个没有说明的游戏里试出规则)。这种能力分布不是一条平滑的曲线,而是一条锯齿线。

这不是 bug,这是架构层面的限制。

大语言模型的核心能力来自于对训练数据中模式的学习和复现。它们非常擅长在「见过类似东西」的领域里发挥。但 ARC-AGI-3 的环境被刻意设计成和任何已有的游戏、任何已有的训练数据都不一样。每个环境都是原创的,只依赖最基本的先验知识:物体性、基本几何、简单物理、施动者概念。不需要语言知识,不需要文化常识,不需要领域专长。

人类为什么能 100% 通关?因为人类天生就会「玩」。给一个 7 岁小孩一个没见过的游戏,他会点点这里、试试那里、观察发生了什么、形成假设、再试。这个探索循环对人来说是本能,对 AI 来说是深渊。

Chollet 的观点一直很明确:如果一个普通人不需要任何说明就能做到的事情,你的系统做不到,那你就没有 AGI。你只有一个非常昂贵的自动补全系统,只不过它需要大量的提示和脚手架。

争议:Seed IQ 事件

在 ARC-AGI-3 正式发布前,2025 年 7-8 月举办过 Agent Preview Competition。第一名 StochasticGoose(Tufa Labs)用 CNN 加强化学习拿到了 12.58%。但正式发布前 ARC Prize 团队大幅增加了游戏难度,加入了动态推动器、移动精灵、跨关卡约束等新机制。加难度之后,深度学习方案从 2-8% 直接坍缩到接近 0%。StochasticGoose 也从 12.58% 掉到了 0.25%。

然后更有意思的事情来了。一个叫 Seed IQ 的系统(AIX Global Innovations 开发)声称在难度提升前就在所有三个公开环境上拿到了 100% 的通过率。难度提升后,它的成绩依然保持在 95%。它在某些关卡上的效率甚至超过了人类基线。

但 Seed IQ 没有出现在官方排行榜上。原因是参赛规则要求提交完整的源代码并授予商业权利。Seed IQ 是闭源系统,他们提出了远程安全评估的替代方案,但 ARC Prize 没有接受。

这个争议我觉得两边都有道理。开源确保了可复现性和学术价值。但如果最强的系统因为 IP 保护无法参赛,那排行榜的含金量就得打个折扣。怎么说呢,这也是整个 AI 评测领域的老问题了。

为什么这很重要

过去两年我们一直在听各种关于 AGI 的宣言。Sam Altman 说我们基本上已经造出了 AGI。微软成立了专攻 ASI(超级人工智能)的实验室。每隔几周就有一个新模型在某个 benchmark 上「碾压人类」。

但 ARC-AGI-3 用一组非常朴素的游戏告诉你:等等,最基本的那个能力,AI 还是零分。

这个测试的设计哲学非常讲究。它只测核心认知能力:探索、建模、目标设定、规划执行。不测记忆力,不测知识量,不测计算速度。这些都是 AI 的强项,但不是智能的本质。

486 个普通人都能通关,不是因为他们聪明,而是因为他们有一种 AI 还没有的能力:在完全陌生的环境中,从零开始理解世界的能力。

这才是 AGI 的真正门槛。不是能不能写代码,不是能不能通过律考,不是能不能在 benchmark 上拿高分。是能不能在一个从没见过的世界里,不靠任何提示,自己搞明白这个世界是怎么运作的。

Chollet 自己的判断是:能够进行范式级创新的高效适应性机器,目前还远远不在我们的触及范围内。

▲ ARC Prize 官网:200 万美元奖金,两条赛道

相关链接

ARC Prize 官网:arcprize.org

论文:arXiv:2603.24621v1

在线试玩:arcprize.org(浏览器直接玩 ARC-AGI-3 游戏)

赶快去 arcprize.org 玩玩 ARC-AGI-3 的游戏吧!试试你能不能在 7 分钟内通关。期待你回来留言反馈!

. . . . .

yrzhe.top 愚人哲 | 关注 AI 前沿,探索技术未来

觉得有帮助?欢迎 点赞、在看、转发 三连支持